NVIDIA ConnectX-6 MCX653106A-HDAT 200Gb/s Adaptador inteligente de banda ancha InfiniBand de doble puerto

Datos del producto:

| Nombre de la marca: | Mellanox |

| Número de modelo: | MCX653106A-HDAT-SP |

| Documento: | connectx-6-infiniband.pdf |

Pago y Envío Términos:

| Cantidad de orden mínima: | 1 Uds. |

|---|---|

| Precio: | Negotiate |

| Detalles de empaquetado: | Caja exterior |

| Tiempo de entrega: | Basado en el inventario |

| Condiciones de pago: | T/T |

| Capacidad de la fuente: | Suministro por proyecto/lote |

|

Información detallada |

|||

| Estado de los productos: | Existencias | Solicitud: | Servidor |

|---|---|---|---|

| Condición: | Nuevo y Original | Tipo: | cableado |

| Velocidad máxima: | Hasta 200 GB/s | Conector de Ethernet: | QSFP56 |

| Modelo: | MCX653106A-HDAT | Nombre: | Caja fuerte elegante de alta velocidad de la tarjeta de red de MCX653106A-HDAT-SP Mellanox 200gbe |

| Resaltar: | Adaptador de banda ancha NVIDIA ConnectX-6,Tarjeta de red Mellanox de 200 Gb/s,Adaptador inteligente InfiniBand de dos puertos |

||

Descripción de producto

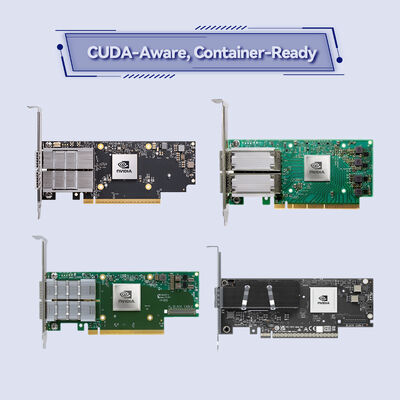

NVIDIA ConnectX-6 MCX653106A-HDAT

Adaptador Inteligente InfiniBand HDR de Doble Puerto de 200 Gb/s

Desbloquee un rendimiento extremo de HPC e IA con la computación en red de NVIDIA. Este adaptador PCIe 4.0 x16 ofrece 215 millones de mensajes/seg y aceleración basada en hardware para los centros de datos más exigentes.

Descripción del Producto

El NVIDIA ConnectX-6 MCX653106A-HDAT es un adaptador inteligente InfiniBand y Ethernet de doble puerto de 200 Gb/s, diseñado como piedra angular de la plataforma NVIDIA Quantum InfiniBand. Integra funciones avanzadas como Acceso Directo a Memoria Remota (RDMA), descargas de NVMe sobre Fabrics (NVMe-oF) y cifrado a nivel de bloque para reducir drásticamente la sobrecarga de la CPU. Al trasladar la computación al tejido de red, este adaptador mejora la escalabilidad y la eficiencia para la computación de alto rendimiento, las cargas de trabajo de aprendizaje automático y las infraestructuras de nube hiperscale.

Características Clave

- Rendimiento Ultra-Alto: Conectividad de 200 Gb/s por puerto con un ancho de banda agregado máximo de 200 Gb/s.

- Computación en Red: Descargas de hardware para operaciones colectivas, coincidencia de etiquetas MPI y protocolo de reunión.

- Cifrado a Nivel de Bloque: Cifrado de hardware XTS-AES de 256/512 bits para seguridad de datos compatible con FIPS.

- Soporte PCIe 4.0: Velocidad de enlace de 16 GT/s con compatibilidad total hacia atrás con PCIe 3.0/2.0/1.1.

- Tasa de Mensajes: Hasta 215 millones de mensajes por segundo para un rendimiento extremo de paquetes pequeños.

- Descargas de Almacenamiento: Descargas de destino e iniciador NVMe-oF, T10-DIF y soporte para SRP, iSER, NFS RDMA.

- Virtualización: SR-IOV con hasta 1K funciones virtuales y ASAP2 para descarga de OVS.

Tecnología de Computación en Red de NVIDIA

ConnectX-6 integra los motores únicos de Computación en Red de NVIDIA, descargando operaciones de comunicación colectiva (como MPI all-reduce) de la CPU al tejido de red. Esto reduce drásticamente la latencia y libera ciclos de CPU para el procesamiento de aplicaciones. Combinado con RDMA y mapeo avanzado de memoria (UMR), el adaptador permite GPU Direct RDMA y comunicación GPU de igual a igual a través de la red, acelerando clústeres de entrenamiento de IA y simulaciones complejas.

Despliegues Típicos

- Computación de Alto Rendimiento (HPC): Clústeres a gran escala que ejecutan simulación meteorológica, dinámica de fluidos computacional y dinámica molecular.

- IA y Aprendizaje Automático: Entrenamiento distribuido de redes neuronales profundas que requieren alto rendimiento y baja latencia.

- Centros de Datos Empresariales: Destinos de almacenamiento NVMe-oF, aceleración de bases de datos e infraestructura virtualizada.

- Nube Hiperscale: Entornos multi-inquilino que requieren aislamiento basado en hardware y QoS.

- Plataformas Refrigeradas por Líquido: Compatible con diseños de placa fría Intel Server System D50TNP para despliegues de alta densidad.

Compatibilidad

Sistema y CPU: Plataformas basadas en x86, Power, Arm, GPU (con GPUDirect) y FPGA.

Conmutadores: Totalmente interoperable con conmutadores NVIDIA Quantum InfiniBand de hasta 200 Gb/s y conmutadores Ethernet estándar.

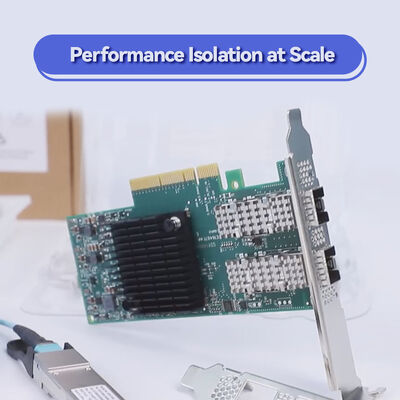

Cables: Cables de cobre pasivos, ópticos activos y DAC con conectores QSFP56.

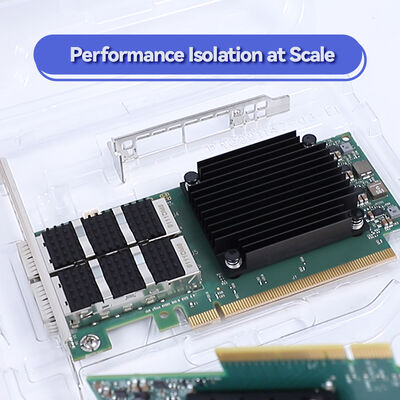

Especificaciones Técnicas

| Parámetro | Detalles |

|---|---|

| Nombre del Producto | NVIDIA ConnectX-6 MCX653106A-HDAT |

| Velocidades Soportadas | InfiniBand: 200/100/50/40/25/10/1Gb/s; Ethernet: 200/100/50/40/25/10/1GbE |

| Puertos de Red | 2x QSFP56 |

| Interfaz de Host | PCIe Gen 4.0/3.0 x16 (también soporta x8, x4, x2, x1) |

| Tasa de Mensajes | Hasta 215 millones de mensajes/seg |

| Características InfiniBand | RDMA, XRC, DCT, ODP, Control de Congestión por Hardware, 16M canales de E/S, 8 VLs + VL15 |

| Descargas Ethernet | RoCE, LSO/LRO, descarga de suma de verificación, RSS/TSS, descarga de VXLAN/NVGRE/Geneve |

| Descargas de Almacenamiento | NVMe-oF (destino/iniciador), T10-DIF, SRP, iSER, SMB Direct |

| Seguridad | Cifrado de bloque XTS-AES de 256/512 bits por hardware, compatible con FIPS |

| Gestión | NC-SI, MCTP sobre SMBus/PCIe, PLDM para Monitor/Firmware, I2C, JTAG |

| Dimensiones | 167.65mm x 68.90mm (sin soportes) |

| Regulaciones | RoHS, compatible con ODCC |

Nota: Las especificaciones se basan en la documentación disponible. Para obtener detalles completos, confirme antes de realizar el pedido.

Guía de Selección: MCX653106A-HDAT

Este modelo es la variante QSFP56 de doble puerto en el factor de forma PCIe stand-up. Soporta tanto InfiniBand como Ethernet a velocidades de hasta 200 Gb/s. Para necesidades de puerto único, considere el MCX653105A-HDAT. Para el factor de forma OCP 3.0, consulte la serie MCX653436A-HDAT.

| Puertos | Factor de Forma | OPN | Caso de Uso |

|---|---|---|---|

| 2x QSFP56 | PCIe Stand-up | MCX653106A-HDAT | Doble puerto de 200 Gb/s para nodos HPC/IA de alta disponibilidad |

| 1x QSFP56 | PCIe Stand-up | MCX653105A-HDAT | Puerto único de 200 Gb/s para cómputo estándar |

| 2x QSFP56 | Socket Direct | MCX654106A-HCAT | Optimización de servidores multi-socket |

Ventajas del ConnectX-6 MCX653106A-HDAT

- E/S a Prueba de Futuro: La preparación para PCIe 4.0 garantiza el ancho de banda para CPUs y GPUs de próxima generación.

- Seguridad por Defecto: El cifrado integrado compatible con FIPS elimina la necesidad de unidades de autocifrado.

- Consolidación de Infraestructura: Un adaptador soporta tanto InfiniBand como Ethernet, simplificando el inventario.

- Almacenamiento Escalable: Las descargas completas de NVMe-oF reducen la carga de la CPU en arquitecturas de almacenamiento desagregadas.

Servicio y Soporte

Respaldado por el experimentado equipo técnico de Hong Kong Starsurge Group, ofrecemos:

- Asistencia de configuración pre-venta para su entorno HPC o empresarial específico.

- Envío global con seguimiento y embalaje seguro.

- Orientación para la actualización de firmware y soporte para la descarga de controladores.

- Servicios de garantía y RMA (los términos pueden variar según la región).

Preguntas Frecuentes

P: ¿Es esta tarjeta compatible con conmutadores Ethernet estándar?

R: Sí, el MCX653106A-HDAT soporta tanto InfiniBand como Ethernet. Puede operar a 200/100/50/40/25/10/1GbE.

P: ¿Soporta NVIDIA GPUDirect?

R: Absolutamente. Soporta GPUDirect RDMA y PeerDirect para comunicación directa de GPU a GPU a través de la red.

P: ¿Cuál es la diferencia entre MCX653106A-HDAT y MCX653106A-ECAT?

R: El sufijo -HDAT indica la variante de alta velocidad que soporta 200 Gb/s, mientras que -ECAT generalmente denota una versión de menor velocidad (100 Gb/s). Siempre verifique con la guía de pedidos.

P: ¿Puedo usar esta tarjeta en una ranura PCIe Gen 3?

R: Sí, es compatible con versiones anteriores de PCIe Gen 3.0, pero el ancho de banda se limitará a ~100 Gb/s por puerto debido al bus más lento.

Precauciones de Instalación

- Asegure un flujo de aire adecuado; el adaptador puede requerir refrigeración activa en entornos densos.

- Utilice solo módulos y cables QSFP56 validados para operación de 200 Gb/s para evitar inestabilidad del enlace.

- Verifique el soporte de bifurcación de ranuras PCIe de su placa base si utiliza la variante Socket Direct.

- Confirme el presupuesto de energía: la tarjeta consume energía de la ranura PCIe; los módulos ópticos de alta potencia pueden requerir consideración de energía adicional.

Acerca de Hong Kong Starsurge Group Co., Limited

Fundada en 2008, Hong Kong Starsurge Group es un proveedor de hardware de red, servicios de TI y soluciones de integración de sistemas impulsado por la tecnología. Servimos a clientes en todo el mundo con productos que incluyen conmutadores de red, NIC, puntos de acceso inalámbricos, controladores y equipos de red relacionados. Nuestro experimentado equipo de ventas y técnico apoya a industrias como gobierno, atención médica, manufactura, educación, finanzas y empresas. Con un enfoque centrado en el cliente, Starsurge se enfoca en calidad confiable, servicio receptivo y soluciones personalizadas que ayudan a los clientes a construir una infraestructura de red eficiente, escalable y confiable. Ofrecemos soluciones IoT, sistemas de gestión de red, desarrollo de software personalizado, soporte multilingüe y entrega global.

Datos Clave de un Vistazo

Matriz de Compatibilidad

| Componente | ¿Soportado? | Notas |

|---|---|---|

| Conmutadores NVIDIA Quantum | Sí | Interoperabilidad HDR completa de 200 Gb/s |

| Placas Base PCIe Gen 4.0 | Sí | Velocidad de línea completa de 200 Gb/s |

| Placas Base PCIe Gen 3.0 | Sí | Limitado a ~100 Gb/s por puerto |

| VMware vSphere | Sí | Controladores disponibles |

| Intel D50TNP Refrigerado por Líquido | SKU Especial | Existe versión de placa fría; confirmar OPN |

Lista de Verificación del Comprador

- Confirme que el servidor tiene una ranura PCIe 4.0 x16 libre (física y eléctricamente).

- Verifique la velocidad del tejido InfiniBand: esta tarjeta es capaz de HDR (200 Gb/s).

- Elija módulos QSFP56 apropiados (SR, LR o DAC) para su distancia.

- Asegure que la energía y la refrigeración sean adecuadas para operación de alta velocidad.

- Verifique el soporte de SO/controladores: RHEL, Ubuntu, Windows Server, etc.