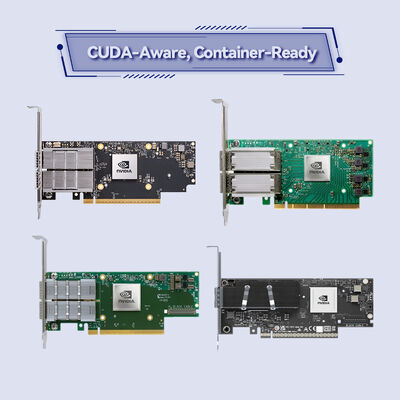

Adaptador InfiniBand NVIDIA MCX555A-ECAT de puerto único de 100 Gb/s QSFP28 PCIe 3.0 x16 ConnectX-5

Datos del producto:

| Nombre de la marca: | Mellanox |

| Número de modelo: | MCX555-ECAT |

| Documento: | CONNECTX-5 infiniband.pdf |

Pago y Envío Términos:

| Cantidad de orden mínima: | 1 Uds. |

|---|---|

| Precio: | Negotiate |

| Detalles de empaquetado: | Caja exterior |

| Tiempo de entrega: | Basado en el inventario |

| Condiciones de pago: | T/T |

| Capacidad de la fuente: | Suministro por proyecto/lote |

|

Información detallada |

|||

| Estado de los productos: | Existencias | Solicitud: | Servidor |

|---|---|---|---|

| Condición: | Nuevo y Original | Tipo: | cableado |

| Velocidad máxima: | EDR y 100GBE | Conector de Ethernet: | QSFP28 |

| Resaltar: | Adaptador InfiniBand NVIDIA ConnectX-5,Tarjeta de red QSFP28 de 100 Gb/s,Tarjeta Mellanox PCIe 3.0 x16 |

||

Descripción de producto

Adaptador de red de alto rendimiento y baja latencia de 100 Gb/s diseñado para centros de datos HPC, IA y en la nube. Con descargas avanzadas que incluyen NVMe sobre Fabrics, GPUDirect RDMA y coincidencia de etiquetas para cargas de trabajo MPI, ofrece un rendimiento líder en la industria y eficiencia de CPU.

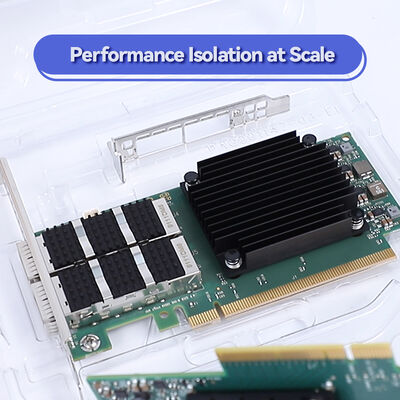

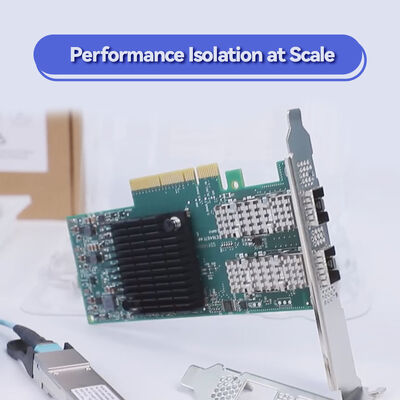

La NVIDIA ConnectX-5 MCX555A-ECAT es una tarjeta adaptadora InfiniBand de puerto único de 100 Gb/s en un factor de forma PCIe de bajo perfil. Aprovechando la probada arquitectura ConnectX-5, ofrece hasta rendimiento de 100 Gb/s con latencia submicrosegundo y alta tasa de mensajes. La tarjeta admite tanto InfiniBand (hasta EDR) como 100 GbE, lo que proporciona conectividad versátil para computación de alto rendimiento, almacenamiento y entornos virtualizados.

Construida con un conmutador PCIe integrado y capacidades RDMA avanzadas, la MCX555A-ECAT descarga tareas de comunicación críticas de la CPU, lo que permite un mayor rendimiento de las aplicaciones, un menor consumo de energía y un menor costo total de propiedad. Es totalmente compatible con ranuras PCIe 3.0 x16 y admite una amplia gama de sistemas operativos y marcos de aceleración.

- Hasta 100 Gb/s de conectividad por puerto (InfiniBand EDR / 100 GbE)

- Conector QSFP28 único para cables ópticos o de cobre

- Interfaz de host PCIe 3.0 x16 (negocia automáticamente a x8, x4, x2, x1)

- RDMA, semántica de envío/recepción con transporte confiable basado en hardware

- Descargas de coincidencia de etiquetas y rendezvous para MPI y SHMEM

- Descargas de destino NVMe sobre Fabrics (NVMe-oF) para almacenamiento eficiente

- Aceleración GPUDirect RDMA (PeerDirect) para comunicación de GPU

- Control de congestión basado en hardware y soporte de enrutamiento adaptativo

- Virtualización SR-IOV: hasta 512 funciones virtuales

- Factor de forma de bajo perfil compatible con RoHS (soporte alto incluido)

La arquitectura ConnectX-5 integra una gama de motores de aceleración de hardware que reducen la intervención de la CPU y mejoran la escalabilidad de las aplicaciones:

- Coincidencia de etiquetas MPI y descarga de Rendezvous: Descarga el emparejamiento de mensajes y el procesamiento del protocolo de rendezvous, mejorando drásticamente el rendimiento de MPI para clústeres HPC.

- RDMA fuera de orden con enrutamiento adaptativo: Permite el uso eficiente de múltiples rutas de red mientras se mantienen semánticas de finalización ordenada, maximizando la utilización de la red.

- Descargas de destino NVMe-oF: Permite que los sistemas de almacenamiento NVMe sirvan acceso remoto con una sobrecarga de CPU casi nula, ideal para arquitecturas de almacenamiento desagregadas.

- Transporte conectado dinámicamente (DCT): Proporciona escalabilidad extrema para sistemas de cómputo y almacenamiento grandes al eliminar la sobrecarga de configuración de la conexión.

- ASAP2 Procesamiento de paquetes y conmutación acelerada: Descarga de hardware para Open vSwitch (OVS) y túneles de red superpuestos (VXLAN, NVGRE, GENEVE).

- Paginación bajo demanda (ODP): Admite paginación de memoria virtual para operaciones RDMA, simplificando el desarrollo de aplicaciones.

- Computación de alto rendimiento (HPC): Ideal para clústeres de supercomputación, simulaciones basadas en MPI y cargas de trabajo de investigación científica que requieren baja latencia y altas tasas de mensajes.

- Entrenamiento de IA y aprendizaje profundo: Combinado con GPUDirect RDMA, permite una comunicación rápida de GPU a GPU a través de nodos, acelerando los tiempos de entrenamiento.

- Sistemas de almacenamiento NVMe-oF: Despliegue como destinos o iniciadores de almacenamiento en entornos NVMe sobre Fabrics para acceso a almacenamiento de bloques de alto rendimiento y baja latencia.

- Centros de datos en la nube y virtualizados: Las descargas SR-IOV y de virtualización admiten entornos multiinquilino con QoS garantizada y aislamiento seguro.

- Trading de alta frecuencia (HFT): La latencia ultrabaja y la marca de tiempo de hardware (IEEE 1588v2) satisfacen las demandas de las aplicaciones de servicios financieros.

La MCX555A-ECAT está diseñada para una amplia compatibilidad con conmutadores NVIDIA InfiniBand (por ejemplo, Quantum, Spectrum) y conmutadores 100 GbE de terceros. Admite DAC de cobre pasivos y cables ópticos activos a través de puertos QSFP28.

Sistemas operativos y pilas de software:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, Platform MPI

- Data Plane Development Kit (DPDK) para omisión del kernel

| Parámetro | Especificación |

|---|---|

| Modelo | MCX555A-ECAT |

| Factor de forma | PCIe de bajo perfil (14,2 cm x 6,9 cm sin soporte), soporte alto preinstalado, soporte corto incluido |

| Velocidad y tipo de puerto | 1x QSFP28, hasta 100 Gb/s InfiniBand (EDR) y 100 GbE |

| Interfaz de host | PCI Express 3.0 x16 (compatible con x8, x4, x2, x1) |

| Soporte InfiniBand | Compatible con IBTA 1.3, 100 Gb/s EDR, FDR, QDR, DDR, SDR; 8 carriles virtuales + VL15; 16 millones de canales de E/S |

| Soporte Ethernet | 100 GbE, 50 GbE, 40 GbE, 25 GbE, 10 GbE, 1 GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| Capacidades RDMA | RDMA sobre Ethernet Convergente (RoCE), transporte confiable de hardware, RDMA fuera de orden, operaciones atómicas |

| Descargas de almacenamiento | Descarga de destino NVMe sobre Fabrics, iSER, SRP, NFS RDMA, SMB Direct, transferencia de firma T10 DIF |

| Virtualización | SR-IOV (hasta 512 funciones virtuales), VMware NetQueue, NPAR, Servicios de control de acceso PCIe (ACS) |

| Descargas de CPU | Descarga sin estado TCP/UDP/IP, LSO/LRO, descarga de suma de verificación, RSS/TSS, inserción/eliminación de etiquetas VLAN/MPLS |

| Redes superpuestas | Descarga de hardware para encapsulación/desencapsulación VXLAN, NVGRE, GENEVE |

| Gestión | NC-SI sobre MCTP, PLDM para monitorización/control y actualización de firmware, I2C, SPI, JTAG |

| Arranque remoto | Arranque remoto sobre InfiniBand, Ethernet, iSCSI; soporte UEFI, PXE |

| Consumo de energía | No especificado públicamente; rango típico inferior a 20 W; confirme para su sistema |

| Temperatura de funcionamiento | 0 °C a 55 °C (entorno típico) |

| Cumplimiento | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Nota: Especificaciones derivadas de la documentación del producto NVIDIA ConnectX-5. Para obtener los últimos detalles y soporte de firmware, consulte las notas de lanzamiento oficiales de NVIDIA.

| Número de pieza de pedido | Puertos / Velocidad | Interfaz de host | Factor de forma | Características clave |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe de bajo perfil | Puerto único estándar, EDR InfiniBand / 100 GbE |

| MCX556A-ECAT | 2x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe de bajo perfil | Doble puerto, EDR/100 GbE |

| MCX556A-EDAT | 2x QSFP28, 100 Gb/s | PCIe 4.0 x16 | PCIe de bajo perfil | ConnectX-5 Ex, PCIe Gen4 mejorado |

| MCX556M-ECAT-S25 | 2x QSFP28, 100 Gb/s | 2x PCIe 3.0 x8 | Socket Direct | Conexión de servidor de doble socket mediante arnés |

| MCX545B-ECAN | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | OCP 2.0 Tipo 1 | Factor de forma Open Compute Project |

Para variantes OCP o multi-host, póngase en contacto con ventas. Todas las tarjetas admiten retrocompatibilidad con velocidades inferiores.

- Rendimiento superior de la aplicación: Las descargas de hardware para MPI, NVMe-oF y superposiciones liberan núcleos de CPU para la lógica empresarial.

- Red RDMA escalable: DCT, XRC y RDMA fuera de orden ofrecen escalabilidad lineal para miles de nodos.

- Listo para aceleración de GPU: GPUDirect RDMA permite el acceso directo a memoria entre GPUs y adaptadores de red, eliminando cuellos de botella de CPU en clústeres de IA.

- Despliegue flexible: El puerto QSFP28 único simplifica el cableado y es ideal para arquitecturas leaf-spine de 100 Gb/s.

- Protección de la inversión: El soporte tanto para InfiniBand como para Ethernet permite una transición fluida entre protocolos a medida que evolucionan las necesidades.

Hong Kong Starsurge Group proporciona soporte completo del ciclo de vida para los adaptadores NVIDIA ConnectX-5, incluida la asistencia de configuración previa a la venta, la orientación para la actualización del firmware y el servicio de garantía. Nuestro equipo técnico puede ayudar con:

- Verificación de compatibilidad con su infraestructura de servidor y conmutador

- Ajuste de rendimiento para cargas de trabajo HPC o de almacenamiento

- Opciones de soporte personalizadas y requisitos de embalaje a granel

- Procesamiento de RMA y servicios de reemplazo avanzado

Póngase en contacto con nuestros ingenieros de ventas para obtener información sobre precios por volumen y plazos de entrega.

Descarga electrostática (ESD): Utilice siempre prácticas seguras contra ESD al manipular el adaptador. Almacene en embalaje antiestático hasta su instalación. Requisitos de refrigeración: Asegure un flujo de aire adecuado en el chasis del servidor para mantener la temperatura de funcionamiento dentro del rango especificado. Actualizaciones de firmware: Utilice las herramientas de firmware oficiales de NVIDIA (MFT) y verifique la compatibilidad con su sistema operativo y versión de controlador antes de actualizar. Curvatura de cables: Siga las pautas del radio de curvatura del cable QSFP28 para evitar la degradación de la señal.

Este es un producto Clase A. En un entorno residencial puede causar interferencias de radio. Asegure un blindaje y una conexión a tierra adecuados según las normativas locales.

Fundada en 2008, Hong Kong Starsurge Group Co., Limited es un proveedor de hardware de red, servicios de TI y soluciones de integración de sistemas impulsado por la tecnología. Sirviendo a clientes en todo el mundo con productos que incluyen conmutadores de red, NIC, puntos de acceso inalámbricos, controladores y cableado de alta velocidad, Starsurge combina una profunda experiencia técnica con un enfoque centrado en el cliente. La empresa apoya a industrias como la gubernamental, la sanitaria, la manufacturera, la educativa, la financiera y la empresarial, ofreciendo soluciones IoT, sistemas de gestión de red, desarrollo de software personalizado y entrega global multilingüe. Con un enfoque en la calidad confiable y el servicio receptivo, Starsurge ayuda a los clientes a construir una infraestructura de red eficiente, escalable y confiable.

| Componente / Sistema | Estado de compatibilidad | Notas |

|---|---|---|

| Conmutadores InfiniBand NVIDIA Quantum | Certificado | Compatibilidad EDR, HDR al usar firmware apropiado |

| Conmutadores Ethernet NVIDIA Spectrum | Certificado | Modos 100 GbE, 50 GbE, 25 GbE compatibles |

| Conmutadores 100 GbE de terceros | Compatible | Requiere cumplimiento de estándares IEEE; probado con los principales proveedores |

| Servidores GPU (NVIDIA DGX, HGX) | Certificado con GPUDirect | Aceleración RDMA para comunicación multi-GPU |

| Arrays de almacenamiento con NVMe-oF | Compatible | La descarga de destino permite un acceso eficiente a la red NVMe |

- ☑ Confirme que el servidor tiene una ranura PCIe 3.0 x16 (o x8) disponible con espacio adecuado.

- ☑ Determine el número de puertos: puerto único (MCX555A-ECAT) vs. puerto doble (MCX556A-ECAT).

- ☑ Elija el tipo de cable: DAC de cobre pasivo para distancias cortas (≤5m) u óptico para tramos más largos.

- ☑ Verifique la compatibilidad del sistema operativo y los controladores (OFED, Windows, VMware).

- ☑ Para clústeres de GPU, asegúrese de la compatibilidad de GPUDirect RDMA con su modelo de GPU y versión de controlador.

- ☑ Verifique si se requiere un soporte alto o corto para el chasis de su servidor.

- NVIDIA MCX556A-ECAT – Adaptador ConnectX-5 de doble puerto de 100 Gb/s

- NVIDIA MCX556A-EDAT – ConnectX-5 Ex con soporte PCIe 4.0

- Conmutador InfiniBand NVIDIA Quantum-2 QM9700 de 40 puertos y 800 Gb/s

- Cables Mellanox QSFP28 DAC pasivos (1m, 2m, 3m)

- Conmutadores Ethernet NVIDIA Spectrum-4 SN5600 de 100 GbE/400 GbE

- Manual del usuario de la tarjeta adaptadora InfiniBand NVIDIA ConnectX-5

- Guía de implementación de RDMA sobre Ethernet Convergente (RoCE)

- Mejores prácticas de GPUDirect RDMA para clústeres de IA

- NVMe sobre Fabrics con ConnectX-5 – Guía de configuración

- Guía de instalación y ajuste de OFED