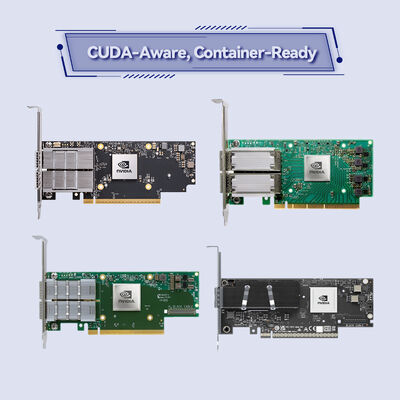

NVIDIA ConnectX-6 InfiniBand Adapter MCX653106A-ECAT 200Gb/s NIC inteligente para el uso en el hogar

Datos del producto:

| Nombre de la marca: | Mellanox |

| Número de modelo: | MCX653106A-ECAT |

| Documento: | connectx-6-infiniband.pdf |

Pago y Envío Términos:

| Cantidad de orden mínima: | 1 Uds. |

|---|---|

| Precio: | Negotiate |

| Detalles de empaquetado: | Caja exterior |

| Tiempo de entrega: | Basado en el inventario |

| Condiciones de pago: | T/T |

| Capacidad de la fuente: | Suministro por proyecto/lote |

|

Información detallada |

|||

| Estado de los productos: | Existencias | Solicitud: | Servidor |

|---|---|---|---|

| Tipo de interfaz:: | Infiniband | Puertos: | Dual |

| Velocidad máxima: | 100GBE | Tipo: | cableado |

| Condición: | Nuevo y Original | tiempo de garantía: | 1 año |

| Modelo: | MCX653106A-ECAT | Nombre: | Tarjeta de red Mellanox Original MCX653106A-ECAT conectar X-6 100Gb/s con doble puerto Adaptador Eth |

| Palabra clave: | Tarjeta de red Mellanox | ||

| Resaltar: | Adaptador de banda ancha NVIDIA ConnectX-6,NIC inteligente de 200 Gbps,Tarjeta de red Mellanox con garantía |

||

Descripción de producto

Adaptador Inteligente de Doble Puerto de 200 Gb/s con Computación en Red

El NVIDIA ConnectX-6 MCX653106A-ECAT ofrece hasta200 Gb/sde ancho de banda, latencia submicrosegunda y descargas de hardware para HPC, IA y almacenamiento hiperconvergente. Con RDMA, aceleración NVMe-oF, cifrado de nivel de bloque XTS-AES y PCIe 4.0, este adaptador InfiniBand QSFP56 de doble puerto maximiza la eficiencia y escalabilidad del centro de datos. Ideal para clústeres de GPU, entrenamiento de ML y redes de misión crítica.

ElMCX653106A-ECATforma parte de la familia de adaptadores InfiniBand NVIDIA ConnectX-6, diseñada para las cargas de trabajo más exigentes. Combina dos puertos QSFP56 capaces de conectividad InfiniBand de 200 Gb/s o Ethernet de 200 Gb/s, ofreciendo transporte fiable basado en hardware, control de congestión y motores de computación en red. Al descargar operaciones colectivas, emparejamiento de etiquetas MPI y cifrado de la CPU del host, el adaptador reduce la sobrecarga de la CPU y aumenta el rendimiento de la aplicación en clústeres a gran escala. Las empresas, los laboratorios de investigación y los centros de datos hiperscale confían en ConnectX-6 para construir redes eficientes energéticamente y de baja latencia.

Hasta 200 Gb/s por puerto (InfiniBand HDR / 200 GbE)

Hasta 215 millones de mensajes/segundo

Nivel de bloque XTS-AES de 256/512 bits, compatible con FIPS

Descargas colectivas, descargas de destino/iniciador NVMe-oF

PCIe Gen 4.0/3.0 x16 (soporte de doble puerto)

SR-IOV hasta 1K VFs, ASAP2, descarga Open vSwitch

Soporte RoCE, XRC, DCT, paginación bajo demanda, enrutamiento adaptativo

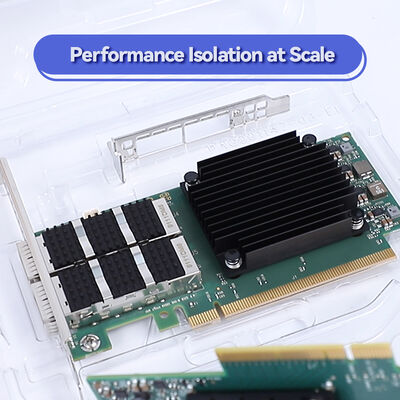

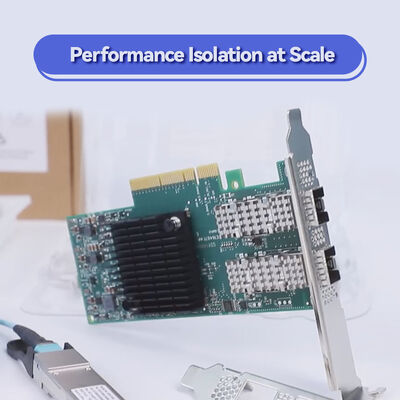

PCIe de pie (bajo perfil), doble puerto QSFP56

Construido sobre la probada arquitectura InfiniBand de NVIDIA, ConnectX-6 integraComputación en Redpara acelerar las operaciones MPI, los marcos de aprendizaje profundo y los protocolos de almacenamiento. El adaptador soportaAcceso Directo a Memoria Remota (RDMA)para transferencias de datos sin copia, evitando la CPU y el kernel. El control de congestión basado en hardware garantiza un rendimiento predecible incluso bajo carga pesada. Además,NVIDIA GPUDirect RDMApermite el intercambio directo de datos entre la memoria de la GPU y el adaptador de red, reduciendo drásticamente la latencia para el entrenamiento de IA. Con soporte paradescargas de NVMe sobre Fabrics (NVMe-oF), la tarjeta reduce la utilización de la CPU en los arrays de almacenamiento al tiempo que permite un acceso de alta velocidad y baja latencia al flash NVMe.

- Computación de Alto Rendimiento (HPC): Simulaciones a gran escala, modelado meteorológico y dinámica de fluidos computacional que requieren baja latencia y alto ancho de banda.

- Clústeres de IA y Aprendizaje Automático: Entrenamiento distribuido de redes neuronales profundas, aprovechando GPUDirect y RDMA para una máxima eficiencia.

- Sistemas de Almacenamiento NVMe-oF: Las descargas de destino o iniciador permiten almacenamiento desagregado de alto rendimiento con baja sobrecarga de CPU.

- Centros de Datos Hiperscale: Entornos virtualizados con SR-IOV, redes superpuestas y encadenamiento de servicios.

- Servicios Financieros: Infraestructura de trading de latencia ultrabaja que requiere rendimiento determinista.

El ConnectX-6 MCX653106A-ECAT es compatible con una amplia gama de servidores, switches y sistemas operativos. Interopera con los switches InfiniBand NVIDIA Quantum (HDR 200 Gb/s), así como con switches Ethernet de 200 GbE. El adaptador soporta ranuras PCIe estándar (x16, x8, x4) e incluye soporte de controladores para las principales plataformas de SO.

| Parámetro | Especificación |

|---|---|

| Modelo de Producto | MCX653106A-ECAT |

| Velocidad de Datos | 200 Gb/s, 100 Gb/s, 50 Gb/s, 40 Gb/s, 25 Gb/s, 10 Gb/s, 1 Gb/s (InfiniBand y Ethernet) |

| Puertos | 2 conectores QSFP56 |

| Interfaz de Host | PCIe Gen 4.0 / 3.0 x16 (soporta configuraciones x8, x4, x2, x1) |

| Latencia | Extremadamente baja, submicrosegundo (típica<0.8µs) |

| Tasa de Mensajes | Hasta 215 millones de mensajes/segundo |

| Cifrado | XTS-AES de 256/512 bits, listo para cumplimiento FIPS 140-2 |

| Factor de Forma | PCIe de bajo perfil de pie (soporte alto montado, soporte corto incluido) |

| Dimensiones (sin soporte) | 167.65mm x 68.90mm |

| Consumo de Energía | Típico 22W (dependiendo del tráfico) |

| Virtualización | SR-IOV (1K VFs), VMware NetQueue, NPAR, descarga de flujo ASAP2 |

| Gestión | NC-SI, MCTP sobre PCIe/SMBus, PLDM para actualización y monitorización de firmware |

| Arranque Remoto | InfiniBand, iSCSI, PXE, UEFI |

| Sistemas Operativos | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, pila OFED |

| Número de Parte de Pedido (OPN) | Puertos | Velocidad Máxima | Interfaz de Host | Diferenciador Clave |

|---|---|---|---|---|

| MCX653106A-ECAT | 2x QSFP56 | 100 Gb/s (también inferior) | PCIe 3.0/4.0 x16 | Doble puerto 100 GbE/IB, descargas avanzadas, ¿cifrado opcional? No hay cifrado incorporado en esta variante, pero soporta cifrado de bloque a través de software? En realidad, motor AES de hardware, consultar especificaciones; ideal para virtualización y almacenamiento |

| MCX653105A-HDAT | 1x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Puerto único de 200 Gb/s, soporte de cifrado |

| MCX653106A-HDAT | 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Doble puerto de 200 Gb/s a pleno ancho de banda, descarga de cifrado |

| MCX653105A-ECAT | 1x QSFP56 | 100 Gb/s | PCIe x16 | Puerto único de 100 Gb/s, entrada de menor costo |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Factor de forma pequeño OCP 3.0, doble puerto |

- Rendimiento de Aplicación Maximizado: Las descargas de hardware para MPI, NVMe-oF y cifrado liberan núcleos de CPU para las cargas de trabajo reales.

- Ancho de Banda Preparado para el Futuro: PCIe 4.0 y preparación para 200 Gb/s garantizan longevidad en redes de alta velocidad.

- Memoria y Computación en Red: Soporta descargas colectivas y buffer de ráfaga, reduciendo la sobrecarga de movimiento de datos.

- Seguridad Confiable: El cifrado AES-XTS a nivel de bloque con cumplimiento FIPS garantiza la protección de datos en reposo y en tránsito sin afectar el rendimiento.

- Gestión Simplificada: Amplio soporte de SO e hipervisor, con pila de controladores unificada (OFED, WinOF-2).

Hong Kong Starsurge Group proporciona soporte técnico completo, cobertura de garantía y servicios RMA para todos los adaptadores NVIDIA ConnectX. Nuestro equipo de ingenieros de redes asiste con la configuración, actualizaciones de firmware y ajuste de rendimiento. Ofrecemos envío global, precios por volumen para proyectos de centros de datos y reservas de stock personalizadas. Para pedidos de volumen, póngase en contacto con nuestro equipo de ventas para recibir cotizaciones personalizadas y detalles de plazos de entrega.

• Confirme que la ranura PCIe proporciona la potencia adecuada (hasta 75W a través de la ranura; este adaptador típicamente usa<25W).

• Para plataformas refrigeradas por líquido, verifique la compatibilidad con Intel Server System D50TNP si se necesita la variante de placa fría (este OPN es refrigerado por aire estándar).

• Verifique la compatibilidad de los controladores del SO con las últimas pilas OFED o WinOF-2.

Desde 2008, Hong Kong Starsurge Group Co., Limited ofrece hardware de red de grado empresarial, integración de sistemas y servicios de TI en todo el mundo. Como socio de confianza para productos de red NVIDIA, Starsurge ofrece soluciones certificadas para centros de datos gubernamentales, financieros, de salud, educativos e hiperscale. Nuestro equipo técnico garantiza una implementación fluida, desde el diseño de arquitectura de preventa hasta el soporte postventa. Con una filosofía centrada en el cliente, proporcionamos componentes de infraestructura personalizados y escalables, incluyendo NICs, switches, cables y soluciones de red de extremo a extremo.

Entrega global · Soporte multilingüe · Servicios OEM disponibles

| Componente / Ecosistema | Soportado | Notas |

|---|---|---|

| Switches NVIDIA Quantum HDR | ✓ Sí | Integración completa de 200 Gb/s en la red |

| Switches Ethernet 200G/100G | ✓ Sí | Requiere transceptor/modos FEC compatibles |

| GPU Direct RDMA | ✓ Sí | Series de GPU NVIDIA soportadas |

| VMware vSphere / ESXi | ✓ Certificado | Controladores nativos, soporte SR-IOV |

| Windows Server 2019/2022 | ✓ Sí | Paquete de controladores WinOF-2 |

| Kernel Linux y OFED | ✓ Soporte completo | MLNX_OFED, controladores inbox |

- Confirme la velocidad de enlace requerida: ¿los puertos duales de 100 Gb/s cumplen con el plan de ancho de banda de su clúster? Para puertos duales de 200 Gb/s, considere el OPN -HDAT.

- Verifique la ranura PCIe del servidor: física x16, se recomienda Gen 3 o Gen 4.

- Compruebe el tipo de cable: cables de cobre pasivos QSFP56 (hasta 5m) o cables ópticos activos para mayor alcance.

- Asegúrese de que los controladores del sistema operativo estén disponibles (OFED, WinOF).

- Para requisitos de cifrado: confirme si se necesita cifrado de bloque incorporado – el MCX653106A-ECAT soporta AES-XTS, pero siempre confirme el nivel FIPS con la hoja de datos de NVIDIA.

- Evalúe las necesidades de virtualización: SR-IOV, descarga VXLAN, etc.