Adaptador NVIDIA ConnectX-7 VPI – Doble puerto NDR 400Gb/s, PCIe 5.0, GPUDirect, RoCE – MCX75310AAS-NEAT

Datos del producto:

| Nombre de la marca: | Mellanox |

| Número de modelo: | MCX75310AAS-NEAT (900-9X766-003N-SQ0) |

| Documento: | Connectx-7 infiniband.pdf |

Pago y Envío Términos:

| Cantidad de orden mínima: | 1 Uds. |

|---|---|

| Precio: | Negotiate |

| Detalles de empaquetado: | Caja exterior |

| Tiempo de entrega: | Basado en el inventario |

| Condiciones de pago: | T/T |

| Capacidad de la fuente: | Suministro por proyecto/lote |

|

Información detallada |

|||

| Modelo NO.: | MCX75310AAS-NEAT (900-9X766-003N-SQ0) | Puertos: | Puerto único |

|---|---|---|---|

| Tecnología: | Infiniband | Tipo de interfaz: | OSFP56 |

| Especificación: | 16,7 cm x 6,9 cm | Origen: | India / Israel / China |

| tasa de transmisión: | 400GBE | Interfaz de host: | Gen3 x16 |

| Resaltar: | Adaptador de red NVIDIA ConnectX-7,Tarjeta PCIe de doble puerto NDR 400Gb/s,Adaptador Mellanox RoCE GPUDirect |

||

Descripción de producto

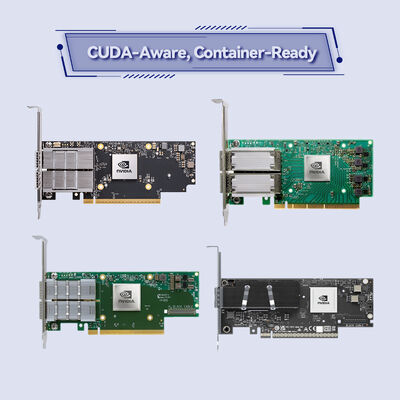

MCX755106AS‑HEAT | NIC Inteligente PCIe 5.0 de Doble Puerto

Acelere las cargas de trabajo de IA, computación científica y nube empresarial con la familia NVIDIA ConnectX-7. El MCX755106AS-HEAT ofrece hasta200 Gb/s InfiniBand (HDR) y 200 GbE Ethernet, motores de computación en red, seguridad a nivel de hardware y latencia ultrabaja, todo ello impulsado por PCIe 5.0.

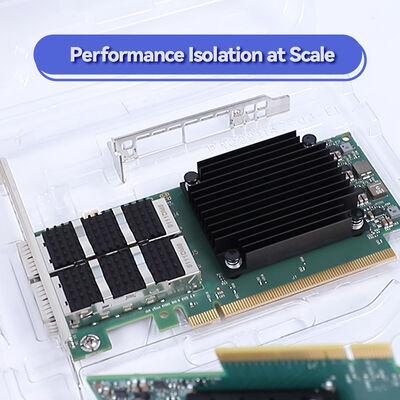

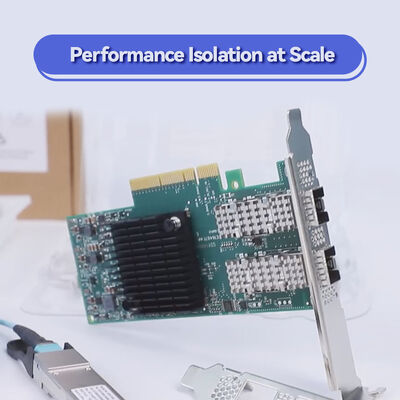

El adaptador NVIDIA ConnectX-7 VPI MCX755106AS-HEAT es una tarjeta de interfaz de red inteligente de doble puerto de 200 Gb/s diseñada para clústeres de computación de alto rendimiento (HPC), fábricas de IA y centros de datos empresariales. Al combinar compatibilidad con protocolos InfiniBand y Ethernet, permite el acceso remoto directo a memoria (RDMA), GPUDirect Storage y motores avanzados de computación en red como SHARPv3 y descarga de rendezvous. Con una interfaz de host PCIe 5.0 y aceleradores de seguridad basados en hardware, este adaptador descarga la CPU, reduce el TCO y ofrece un rendimiento constante de baja latencia.

Ideal para organizaciones que modernizan su infraestructura de TI desde el borde hasta el núcleo, la familia ConnectX-7 ofrece redes, almacenamiento y seguridad definidos por software y acelerados por hardware, lo que permite soluciones escalables y seguras con una sobrecarga mínima.

ConnectX-7 integra la tecnología NVIDIA ASAP² (Procesamiento Acelerado de Conmutadores y Paquetes) para ofrecer redes definidas por software a velocidad de línea sin consumir núcleos de CPU. Los motores de hardware en línea manejan el cifrado/descifrado para IPsec, TLS y MACsec, protegiendo los datos en movimiento desde el borde hasta el núcleo. Para el almacenamiento, la descarga NVMe-oF integrada y GPUDirect Storage permiten el movimiento directo de datos entre la memoria de almacenamiento y la GPU, reduciendo la latencia y maximizando el rendimiento. El adaptador también admite sincronización horaria avanzada (PTP con precisión de 12 ns) y paginación bajo demanda (ODP) para RDMA sin registro, lo que lo hace ideal para arquitecturas desagregadas y centradas en la memoria.

- Clústeres de IA y Modelos de Lenguaje Grandes (LLM): Interconexión de alta velocidad para servidores GPU, aprovechando GPUDirect RDMA y descargas colectivas SHARP.

- Computación de Alto Rendimiento (HPC): Tejido InfiniBand HDR de 200 Gb/s para MPI, OpenSHMEM y simulaciones científicas.

- Centros de Datos de Nube Hiperscale y SDN: RoCEv2, aceleración de superposición y SR-IOV para virtualización multitenant.

- Pasarela de Seguridad Empresarial: Cifrado MACsec/IPsec en línea para comunicaciones de borde a núcleo con descarga de hardware.

- Sistemas de Almacenamiento: Descarga NVMe-oF/TCP, plataformas de almacenamiento distribuidas que requieren latencia ultrabaja y alto IOPS.

✅ Sistemas Operativos: Controladores incluidos para Linux (RHEL, Ubuntu), Windows Server, VMware ESXi (SR-IOV), Kubernetes (plugins CNI).

✅ Protocolos: InfiniBand (HDR/EDR), Ethernet (200 GbE a 10 GbE), RoCE, RoCEv2, iSCSI, NVMe-oF, SRP, iSER, NFS sobre RDMA, SMB Direct.

✅ Middleware HPC: NVIDIA HPC-X, UCX, UCC, NCCL, OpenMPI, MVAPICH, MPICH, OpenSHMEM.

✅ Gestor: NC-SI, MCTP sobre PCIe/SMBus, PLDM, Redfish, SPDM, actualización segura de firmware.

| Especificación | Detalles |

|---|---|

| Modelo del Producto | MCX755106AS-HEAT (NVIDIA ConnectX-7 VPI) |

| Velocidad Máxima | InfiniBand HDR 200 Gb/s; Ethernet hasta 200 GbE |

| Configuración de Puertos | Doble puerto (admite variantes de 1/2 puerto, este modelo es de doble puerto QSFP56) |

| Interfaz de Host | PCIe 5.0 x16 (hasta x32 carriles con bifurcación / Múltiples Hosts) |

| Factor de Forma | PCIe HHHL (Half Height Half Length) – soporte estándar |

| Compatibilidad de Protocolos | InfiniBand (HDR/EDR) y Ethernet (200 GbE/100 GbE/50 GbE/25 GbE/10 GbE) |

| RDMA | RoCE, RoCEv2, transporte fiable de hardware, DCT, XRC, paginación bajo demanda (ODP) |

| Descarga de Seguridad | IPsec/TLS/MACsec en línea (AES-GCM de 128/256 bits), arranque seguro, cifrado de flash, atestación de dispositivo |

| Descarga de Almacenamiento | NVMe-oF (TCP/Fabrics), NVMe/TCP, T10-DIF, XTS-AES de 256/512 bits a nivel de bloque |

| Temporización y Sincronización | IEEE 1588v2 (PTP), precisión de 12 ns, SyncE (G.8262.1), PPS configurable, programación por tiempo |

| Virtualización | SR-IOV, aceleración VirtIO, descarga de superposición (VXLAN, GENEVE, NVGRE) |

| Funciones Avanzadas | GPUDirect RDMA, GPUDirect Storage, descarga SHARP, enrutamiento adaptativo, descarga de búfer de ráfaga |

| Gestor y Arranque | UEFI, PXE, arranque iSCSI, arranque remoto InfiniBand, PLDM, Redfish, SPDM, MCTP |

*Las especificaciones se basan en la documentación pública de NVIDIA. Verifique la configuración exacta para su sistema antes de realizar el pedido.

| Modelo | Puertos / Velocidad | Interfaz de Host | Objetivo Principal |

|---|---|---|---|

| MCX755106AS-HEAT | 2 puertos InfiniBand HDR de 200 Gb/s / 200 GbE | PCIe 5.0 x16 | Clústeres de IA, HPC, centros de datos empresariales |

| MCX75310AAS-NEAT | 2 puertos InfiniBand NDR de 400 Gb/s | PCIe 5.0 x16 | IA de gama alta, HPC a gran escala |

| Variantes OCP 3.0 | SFF / TSF con HDR/NDR | PCIe Gen5 | Servidores Open Compute Project |

- Latencia ultrabaja y alto rendimiento: RDMA de hardware y computación en red minimizan la latencia de cola de la aplicación.

- Tejido unificado: Un adaptador admite tanto InfiniBand como Ethernet, simplificando el inventario y el despliegue.

- PCIe 5.0 preparado para el futuro: 32 GT/s por carril, el doble de ancho de banda que PCIe 4.0, eliminando cuellos de botella de E/S.

- TCO reducido: Descarga la CPU de tareas de red, almacenamiento y seguridad, lo que permite una utilización más eficiente del servidor.

- Optimizado para IA: GPUDirect nativo y operaciones colectivas SHARPv3 aceleran el entrenamiento e inferencia de modelos.

Hong Kong Starsurge Group Co., Limited proporciona soporte de extremo a extremo, incluyendo consultoría de preventa, configuración de firmware personalizada y envíos a nivel mundial. Todos los adaptadores ConnectX-7 están respaldados por una garantía de 1 año (extensible) y asistencia técnica de ingenieros de red experimentados. Ofrecemos soporte multilingüe, servicios RMA y logística de reemplazo rápida para minimizar el tiempo de inactividad.

- Asegúrese de que la ranura PCIe proporcione suficiente energía (75W a través de la ranura, no se requiere alimentación auxiliar para el funcionamiento estándar).

- Verifique el espacio físico: el factor de forma HHHL cabe en la mayoría de los servidores 1U/2U; las variantes OCP requieren una ranura mezzanine correspondiente.

- Para el despliegue de RoCE, configure DCB (Priority Flow Control) y ECN en los conmutadores para Ethernet sin pérdidas.

- Actualice siempre el firmware a la última versión estable para aprovechar las mejoras de seguridad y rendimiento.

Fundada en 2008, Hong Kong Starsurge Group Co., Limited es un proveedor de hardware de red, servicios de TI y soluciones de integración de sistemas impulsado por la tecnología. Servimos a clientes en todo el mundo con productos que incluyen conmutadores de red, NIC, puntos de acceso inalámbricos, controladores, cables y equipos de red. Nuestro experimentado equipo de ventas y técnico apoya a industrias como la gubernamental, la salud, la manufactura, la educación, las finanzas y las empresas. Con un enfoque centrado en el cliente, Starsurge se enfoca en calidad confiable, servicio receptivo y soluciones personalizadas, ayudando a los clientes a construir una infraestructura de red eficiente, escalable y confiable.

Proporcionamos soluciones de IoT, sistemas de gestión de red, desarrollo de software personalizado, soporte multilingüe y entrega global. Elija Starsurge como su socio de confianza para soluciones de red NVIDIA.