Adaptador NVIDIA ConnectX-6 InfiniBand MCX653105A-HDAT – Cifrado de hardware RDMA de 200 Gb/s

Datos del producto:

| Nombre de la marca: | Mellanox |

| Número de modelo: | MCX653106A-HDAT-SP |

| Documento: | connectx-6-infiniband.pdf |

Pago y Envío Términos:

| Cantidad de orden mínima: | 1 Uds. |

|---|---|

| Precio: | Negotiate |

| Detalles de empaquetado: | Caja exterior |

| Tiempo de entrega: | Basado en el inventario |

| Condiciones de pago: | T/T |

| Capacidad de la fuente: | Suministro por proyecto/lote |

|

Información detallada |

|||

| Estado de los productos: | Existencias | Solicitud: | Servidor |

|---|---|---|---|

| Condición: | Nuevo y Original | Tipo: | cableado |

| Velocidad máxima: | Hasta 200 GB/s | Conector de Ethernet: | QSFP56 |

| Modelo: | MCX653106A-HDAT | Nombre: | Caja fuerte elegante de alta velocidad de la tarjeta de red de MCX653106A-HDAT-SP Mellanox 200gbe |

Descripción de producto

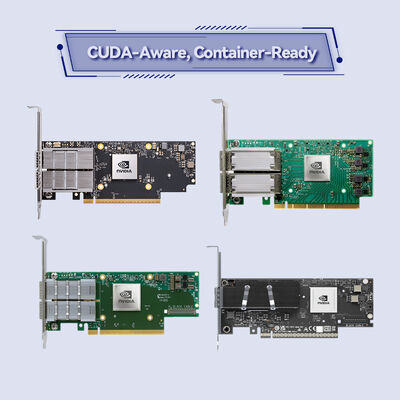

MCX653105A-HDAT con puerto único de 200 Gb/s

Diseñada para infraestructuras HPC, IA e infraestructuras de nube de hiperescala exigentes, la tarjeta de adaptador inteligente NVIDIA® ConnectX®-6 MCX653105A-HDAT ofreceancho de banda de 200 Gb/sDescarga el movimiento de datos críticos y las tareas de seguridad de la CPU, mejora drásticamente la eficiencia, la escalabilidad,y seguridad desde el entrenamiento de redes neuronales profundas hasta el análisis de datos en tiempo real y el almacenamiento NVMe-oF.

Como componente central de la plataforma NVIDIA Quantum InfiniBand, ConnectX-6 permite RDMA de extremo a extremo, transporte confiable basado en hardware y control de congestión avanzado.El valor de las emisiones de gases de efecto invernadero es el valor de las emisiones de gases de efecto invernadero.El modelo de puerto único ofrece una entrada rentable pero poderosa en redes HDR InfiniBand y 200GbE de 200Gb/s. Integra el cifrado XTS-AES a nivel de bloque, NVMe sobre descargas de tejidos (NVMe-oF),y GPUDirect RDMA aceleración haciendo que sea la opción ideal para los clústeres acelerados por GPU, almacenamiento definido por software y entornos de comercio de alta frecuencia donde la baja latencia y la seguridad son primordiales.

NVIDIA ConnectX-6 extiende el acceso remoto directo a la memoria (RDMA) más allá de los límites convencionales.y Transporte Dinámicamente Conectado (DCT), garantiza una escalabilidad eficiente a través de miles de nodos.Memoria en redLa capacidad permite el acceso a la memoria RDMA sin registro, reduciendo los gastos generales de software.0, los datos se mueven directamente entre la memoria y la red, liberando ciclos de CPU para la lógica de aplicación.transporte fiable basado en hardware y control de flujo de extremo a extremo a nivel de paquete garantizan la integridad de los datos incluso bajo una carga extrema.

Con el apoyo deRoCE (RDMA sobre Ethernet convergente)ConnectX-6 proporciona un tejido inteligente unificado para entornos InfiniBand y Ethernet.

- Computación de alto rendimiento (HPC):Simulaciones a gran escala, modelado del tiempo, química computacional que requieren una latencia determinista baja.

- IA y aprendizaje automático:Acelerar el entrenamiento distribuido de redes neuronales profundas con GPUDirect RDMA y rendimiento de 200Gb/s.

- Arrays de almacenamiento NVMe-oF:Construir objetivos de almacenamiento NVMe/TCP o NVMe/RDMA de alto rendimiento con descargas de hardware, reduciendo la carga de la CPU hasta en un 30%.

- Nube de hiperescala y NFV:Cadenas de servicio eficientes, descarga de OVS (ASAP2) y SR-IOV para funciones virtuales de hasta 1K.

- Servicios financieros y comercio:Distribución de datos de mercado de latencia ultrabaja e infraestructura de negociación algorítmica.

ConnectX-6 MCX653105A-HDAT es compatible con una amplia gama de servidores, switches y entornos operativos.Conmutadores de banda Infini hasta 200 Gb/s (HDR)yConmutación Ethernet hasta 200 Gb/sEl adaptador funciona en plataformas x86, Power, Arm, GPU y FPGA.

| Categoría | Opciones / normas apoyadas |

|---|---|

| Sistemas operativos | RHEL, SLES, Ubuntu, otras distribuciones principales de Linux, Windows Server, FreeBSD, VMware vSphere |

| Especificación de banda Infini | Compatible con IBTA 1.3, 200/100/50/25/10Gb/s, 8 carriles virtuales + VL15, control de congestión basado en hardware |

| Normas de Ethernet | 200/100/50/40/25/10/1GbE, IEEE 802.3bj, 802.3by, 802.3ba, PFC, ETS, DCB, 1588v2, Jumbo frame (9.6KB) |

| Descargas de la CPU y virtualización | SR-IOV (hasta 1K VF), NPAR, DPDK, descarga ASAP2 OVS, encapsulación/desencapsulación de túneles (VXLAN, NVGRE, Ginebra) |

| Administración y arranque | NC-SI, MCTP a través de SMBus/PCIe, PLDM (DSP0248/DSP0267), UEFI, PXE, arranque remoto iSCSI, arranque remoto de InfiniBand |

| Parámetro | Detalle |

|---|---|

| Modelo de producto | El valor de las emisiones de gases de efecto invernadero es el valor de las emisiones de gases de efecto invernadero. |

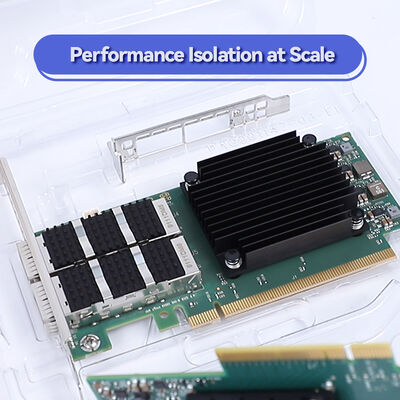

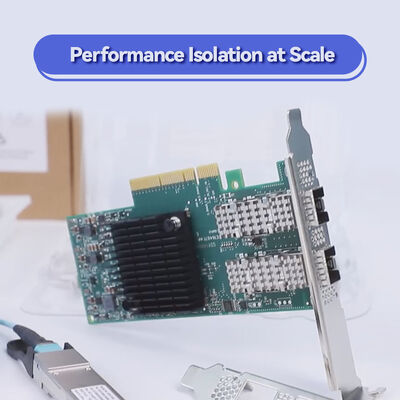

| Factor de forma | PCIe de pie, soporte de perfil bajo incluido, soporte alto montado, soporte corto como accesorio |

| Puertos de red | 1x QSFP56 (puerto único) |

| Velocidades admitidas (InfiniBand) | Se aplicará el método de cálculo de las emisiones de gases de efecto invernadero en el caso de las emisiones de gases de efecto invernadero. |

| Velocidades admitidas (Ethernet) | Se aplicará el método de cálculo de las emisiones de gases de efecto invernadero en el caso de las emisiones de gases de efecto invernadero. |

| Interfaz de host | PCIe Gen 3.0/4.0 x16 (también soporta x8, x4, x2, x1) |

| Ancho de banda máximo | 200 Gb/s |

| Tasa de mensajes | Hasta 215 millones de mensajes por segundo |

| La latencia | Extremadamente baja (RDMA de menos de un microsegundo) |

| Encriptación de hardware | Encriptación a nivel de bloque de 256/512 bits XTS-AES, con capacidad FIPS |

| Descargas de almacenamiento | El objetivo/iniciador de NVMe-oF, T10-DIF, SRP, iSER, NFS RDMA, SMB Direct |

| Virtualización | SR-IOV (hasta 1K VF), VMware NetQueue, calidad de servicio por máquina virtual |

| Inicio por control remoto | Se aplican las reglas siguientes: |

| Las dimensiones (sin soporte) | 167.65 mm x 68.90 mm |

| RoHS y cumplimiento | Conforme con la Directiva RoHS, compatible con la Directiva ODCC |

| Número de la pieza de pedido (OPN) | Puertos / velocidad | Interfaz de host | Características clave |

|---|---|---|---|

| El valor de las emisiones de gases de efecto invernadero es el valor de las emisiones de gases de efecto invernadero. | 1x QSFP56, hasta 200Gb/s | Las medidas de seguridad se aplican a los vehículos de las categorías M1 y M2. | Puerto único, soporte de criptomonedas, soporte estándar |

| El valor de las emisiones de gases de efecto invernadero es el valor de las emisiones de gases de efecto invernadero. | 2x QSFP56, hasta 200Gb/s | Las medidas de seguridad se aplican a los vehículos de las categorías M1 y M2. | Dual-port, soporte de criptomonedas |

| Se aplicará el método de ensayo de la norma de la Nomenclatura. | 1x QSFP56, hasta 100Gb/s | Las medidas de seguridad se aplican a los vehículos de las categorías M1 y M2. | Variante de 100Gb/s, sin cifrado |

| El valor de las emisiones de gases de efecto invernadero se calculará en función de las emisiones de gases de efecto invernadero. | 1x QSFP56, 200Gb/s | El PCIe x16 | OCP 3.0 pequeño factor de forma |

| Se aplicará el procedimiento de ensayo de la norma de calidad. | 1x QSFP56, conexión directa | 2x PCIe 3.0 x16 | Socket Direct con acceso dedicado a la CPU |

Nota: Para las variantes de placas frías para el sistema de servidor Intel D50TNP refrigerado con líquido, póngase en contacto con Starsurge para realizar un pedido personalizado.

Adaptadores NVIDIA ConnectX-6 100% auténticos con trazabilidad de lote completo.

Centros de almacenamiento en Asia, Europa y América que sirven a más de 50 países.

Configuración del firmware, ajuste RDMA, validación NVMe-oF, asistencia al conductor.

Colaboración a largo plazo con distribuidores de NVIDIA, descuentos de volumen disponibles.

Reemplazo sin complicaciones y avanzado cruce de buques para despliegues críticos.

Apoyo en inglés, chino y japonés; integración y etiquetado personalizados.

Hong Kong Starsurge Group proporciona soporte de extremo a extremo: desde comprobaciones de compatibilidad, personalización de firmware, hasta orientación de implementación in situ.Ofrecemos administradores de cuentas técnicas dedicados para actualizaciones de centros de datos y pruebas de prueba de concepto (PoC)Todos los adaptadores vienen con un embalaje antiestático y kits de instalación opcionales.

Las ofertas de apoyo incluyen:Sistema de ticketing de soporte de ingeniería 24/5, reemplazo avanzado para entornos críticos para el negocio, soporte para controladores y software (OFED, WinOF-2, DPDK) y resolución de problemas remotos.

- Confirmar el espacio libre mecánico del servidor: soporte PCIe de altura estándar incluido; soporte de perfil bajo también proporcionado como accesorio.

- Para las plataformas refrigeradas por líquido (Intel D50TNP), verifique la disponibilidad de la opción de placa fría antes de ordenar el soporte refrigerado por aire estándar por defecto.

- Por favor, confirme la compatibilidad del controlador con su versión de distribución de Linux. NVIDIA MLNX_OFED recomendado para un rendimiento óptimo.

- No especificado públicamente: Consumo de energía exacto a plena carga de 200Gb / s

- La certificación FIPS es compatible con el hardware, pero puede requerir una versión de firmware específica ¢ notifique al equipo de ventas si el cumplimiento de FIPS es obligatorio para su implementación.

- El adaptador de puerto único no se puede utilizar para la redundancia de puertos; para los diseños de alta disponibilidad, considere el MCX653106A-HDAT de doble puerto.

Fundada en 2008,Hong Kong Starsurge Group Co., Ltd. y sus subsidiariasEs un proveedor de hardware de red, servicios de TI y soluciones de integración de sistemas, con una base de clientes global que abarca gobiernos, salud, manufactura, educación, finanzas,y sectores empresariales, Starsurge ofrece equipos de red de alto rendimiento que incluyen switches, NIC, soluciones inalámbricas y software personalizado.La empresa combina equipos de ventas y técnicos experimentados para apoyar proyectos de infraestructura complejosEl enfoque centrado en el cliente, la calidad confiable y la entrega global receptiva hacen de Starsurge un socio confiable para los centros de datos de próxima generación.

Contacta con el equipo de Starsurge| Hecho | Valor |

|---|---|

| Producción máxima | 200 Gb/s (puerto único) |

| Motores de aceleración en el chip | Compatibilidad de etiquetas, descarga de encuentro, descargas colectivas, descarga de búfer de explosión |

| Funciones virtuales máximas | Hasta 1024 VF por adaptador |

| Estándar de cifrado | XTS-AES de 256/512 bits, hardware descargado de la CPU |

| Apoyo de enrutamiento adaptativo | RDMA fuera de orden con enrutamiento adaptativo |

| Memoria en red | Acceso a la memoria RDMA sin registro |

| Servidor / Plataforma | Arquitectura de la CPU | Sistema operativo / entorno probado |

|---|---|---|

| Se trata de un sistema de control de velocidad de la unidad. | Intel Xeon Escalable Gen 3/4 | RHEL 8.6+ y Ubuntu 22.04, VMware ESXi 7.0/8.0 |

| Se aplicarán las siguientes medidas: | El Intel Xeon | SLES 15 SP4, Windows Server 2022 (incluida la versión de actualización de Windows) |

| Supermicro Ultra Superservidor | El valor de las emisiones de dióxido de carbono es el valor de las emisiones de dióxido de carbono | Ubuntu 20.04/22 también.04, Rocky Linux 8 |

| Se trata de un sistema de control de velocidad. | Intel / AMD EPYC también | RHEL 9, servidor de Windows 2019 |

| NVIDIA DGX A100 / H100 | x86_64 / NVIDIA Arm también | Ubuntu con MLNX_OFED, NVIDIA HPC SDK |

- Disponibilidad de ranuras PCIe: x16 mecánico (x16 eléctrico/x8/x4 soportado)

- Velocidad de puerto requerida: 200 Gb/s o menos; tipo de cable (DAC pasivo QSFP56 u óptica activa)

- Versión del controlador del sistema operativo: Compruebe la compatibilidad de MLNX_OFED o WinOF-2 con su núcleo

- Requisito de cifrado: modo estándar AES-XTS o FIPS (firmware especial)

- ¢ Refrigeración y soporte: opción estándar de refrigeración por aire o placa fría para refrigeración por líquido

- Cantidad y tiempo de entrega: Confirmación del stock con el equipo de ventas de Starsurge

- ¿Es suficiente con un puerto único o es necesaria una redundancia de dos puertos?

Serie QM8700 / QM9700, 40 puertos HDR 200Gb/s, totalmente gestionado

Optimizado para Ethernet y RoCE, 200Gb/s con baja potencia

InfiniBand/Ethernet con ruta de datos programable y aislamiento

DAC, AOC y cables de fibra activa para 200G QSFP56

- ▸ Manual de usuario de NVIDIA ConnectX-6 (Guía de firmware y configuración)

- ▸ RDMA sobre Ethernet convergente (RoCE) Mejores prácticas de implementación

- ▸ NVMe-oF con ConnectX-6: Guía de ajuste de rendimiento

- ▸ GPUDirect RDMA para grupos de inteligencia artificial

- ▸ Configuración de cifrado a nivel de bloque para entornos FIPS